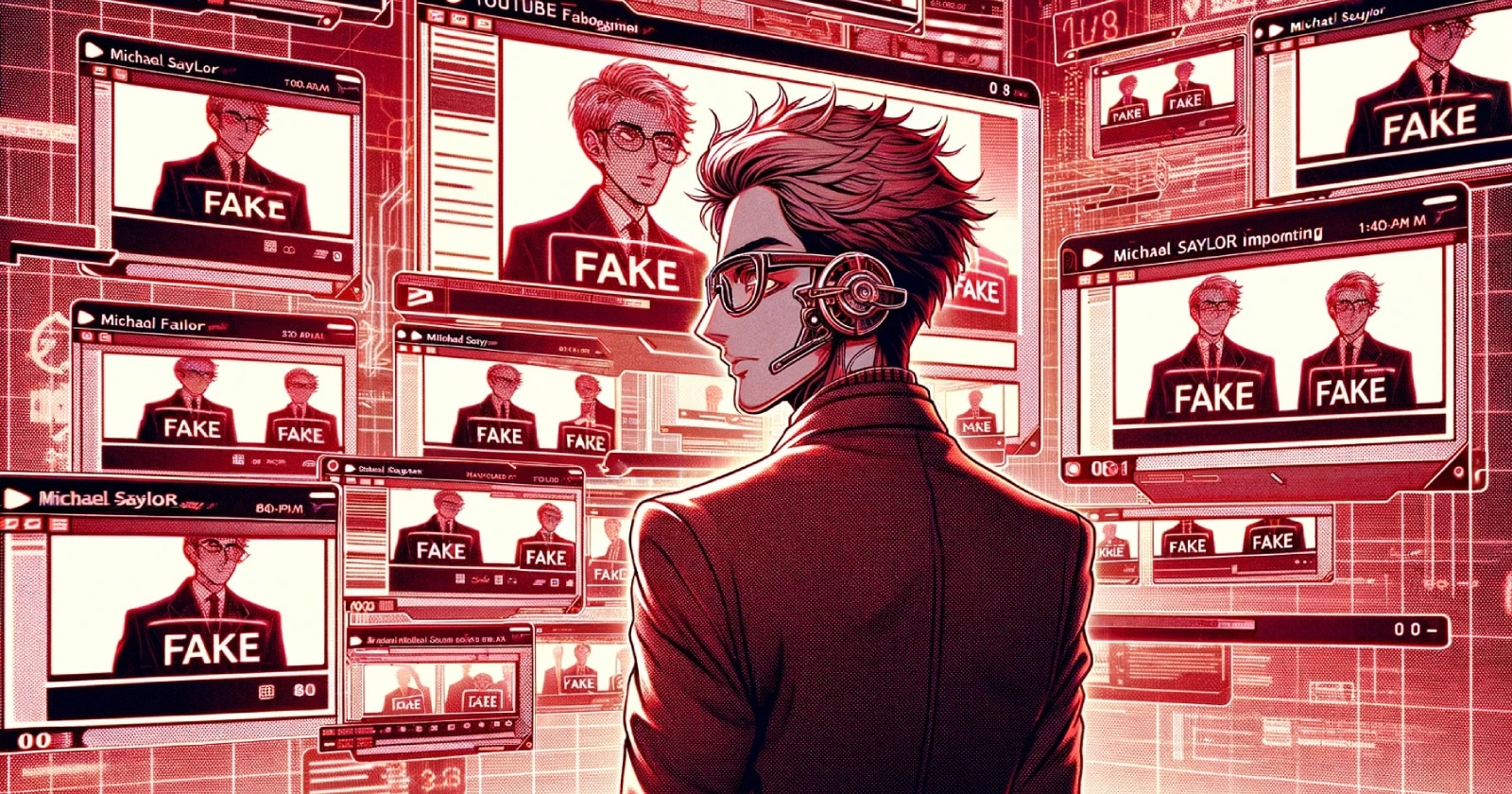

Michael Saylor, presidente executivo da MicroStrategy, revelou que sua equipe trabalha diariamente para remover cerca de 80 vídeos falsos gerados por inteligência artificial (IA) que o retratam, a maioria promovendo algum tipo de golpe relacionado ao Bitcoin.

⚠️ Warning ⚠️ There is no risk-free way to double your #bitcoin, and @MicroStrategy doesn't give away $BTC to those who scan a barcode. My team takes down about 80 fake AI-generated @YouTube videos every day, but the scammers keep launching more. Don't trust, verify. pic.twitter.com/gqZkQW02Ji

— Michael Saylor (@saylor) January 13, 2024

Em uma publicação de 13 de janeiro no X (antigo Twitter), Saylor alertou seus 3,2 milhões de seguidores sobre o grande número de vídeos deep fake encontrados no YouTube, advertindo que ‘os golpistas continuam lançando mais’.

Ele reiterou que ‘não há maneira livre de riscos de dobrar seus bitcoins e a MicroStrategy não dá BTC para quem escaneia um código de barras’.

A evolução dos golpes de phishing com IA

Na última semana, vários usuários no X relataram vídeos falsos gerados por IA com Saylor supostamente prometendo dobrar o dinheiro das pessoas. Os vídeos incentivam os espectadores a escanear um código QR para enviar BTC para o endereço do golpista.

https://twitter.com/iBobbyShell/status/1744527813917528393

Em 2022, uma situação semelhante surgiu com uma série de vídeos falsos de Elon Musk aparecendo na plataforma de streaming de vídeo. No início de janeiro, um vídeo deepfake apresentando Anatoly Yakovenko, co-fundador da Solana, circulou no YouTube e nas redes sociais.

Austin Federa, chefe de estratégia da Fundação Solana, disse em uma entrevista ao The Verge que ‘houve um aumento substancial em deepfakes e outros conteúdos gerados por IA recentemente’.

Desafios e soluções no combate a golpes de IA

Em dezembro de 2023, especialistas em cibersegurança alertaram que vídeos deep fake alimentados por IA se tornarão mais realistas à medida que a tecnologia de IA avança.

Jesse Leclere, analista de blockchain da CertiK, disse que o phishing está evoluindo em sofisticação, e um dos elementos-chave que impulsionam sua evolução é a IA gerativa. Jerry Peng, pesquisador da 0xScope, acrescentou que a IA pode formar um componente chave na geração de deepfakes cada vez mais realistas para enganar usuários de cripto.

Em 9 de janeiro, autoridades policiais dos Estados Unidos alertaram que ferramentas de IA gerativa podem diminuir a barreira técnica de entrada para golpistas em potencial. No entanto, Rob Joyce, diretor de cibersegurança da Agência de Segurança Nacional, também argumentou que a IA poderia ajudar as autoridades a rastrear atividades ilegais de forma mais eficiente.